DGLFLF - La Langue des signes française Les langues des signes Les langues des signes (LS), langues gestuelles utilisées par les sourds, assurent toutes les fonctions remplies par les autres langues naturelles (dites « langues orales », LO, ou « vocales »). Visuo-gestuelles, elles sont, pour les sourds, le seul mode linguistique véritablement approprié, le seul qui leur permette un développement cognitif et psychologique d’une manière équivalente à ce qu’il en est d’une langue orale pour un entendant. Les langues des signes sont, comme toute langue, des systèmes nécessitant chacun un apprentissage, preuve s’il en était besoin qu’il s’agit bien là de “langues naturelles” et non d’un moyen universel et primitif de communication. Ce qui est vrai, cependant, c’est que deux sourds maîtrisant chacun une langue des signes différente parviennent à se comprendre et à communiquer dans un délai très bref, sans commune mesure avec ce qu’il en est pour deux locuteurs de langues orales (LO) différentes. La Langue des Signes Française (LSF)

Alphabet dactylologique Un article de Wikipédia, l'encyclopédie libre. Un alphabet unimanuel publié dans the American Annals of the Deaf and Dumb, 1886. En langue des signes française (LSF), il s'effectue avec la main droite pour les droitiers et la main gauche pour les gauchers. Ces codes alternatifs ne font pas partie de la structure interne d'une langue des signes naturelle et ne sont pas nécessaires dans une conversation entre locuteurs d'une langue des signes appartenant à la même communauté. Historique[modifier | modifier le code] L'alphabet de la langue des signes française (LSF) a été, sinon inventé, du moins propagé par Charles-Michel de L'Épée au XVIIIe siècle. Composition[modifier | modifier le code] L'alphabet de la LSF, de l'ASL et de la LSQ sont composés de vingt-six signes plus ou moins arbitraires pour les lettres de l'alphabet, mais dont la majorité évoque la graphie de l'alphabet latin. Alphabet de la LSF[modifier | modifier le code] Pour ces images, il s'agit d'un signeur droitier.

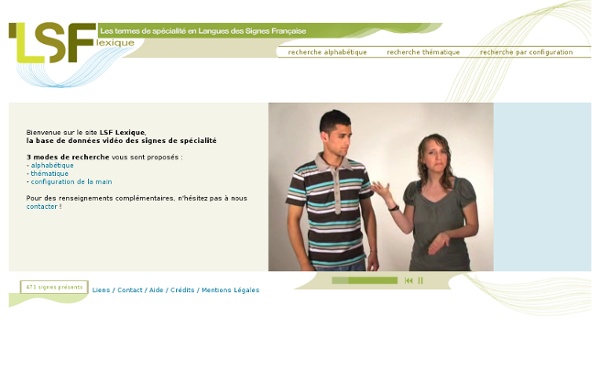

Langue des signes Un article de Wikipédia, l'encyclopédie libre. Pour les articles homonymes, voir Signe. Lettre V en langue des signes. La langue des signes désigne l'une ou l'autre des langues gestuelles (produites par les mouvements des mains, du visage et du corps dans son ensemble) que les personnes atteintes de surdité ont développées pour communiquer. Elle assure toutes les fonctions remplies par les langues orales. Histoire[modifier | modifier le code] Séméiologie[modifier | modifier le code] Si la langue des signes est enseignée et diffusée, elle est conçue en tant que « reproduction » d'une langue qu'elle visualise et gestualise. Comme toute langue, une langue des signes nécessite un apprentissage mais il n'est pas nécessaire d'avoir une surdité pour apprendre ou communiquer en langue des signes. On parle souvent quand on traite de la langue des signes d'une « pensée visuelle ». Code gestuel[modifier | modifier le code] Prosodie illustrative[modifier | modifier le code] Art.

Petit cours de novlangue Connaissez-vous la novlangue? Il s’agit d’une langue inventée par Georges Orwell dans le roman 1984 qui bizarrement, n’a jamais été adapté au cinéma en tant que super-production alors que le roman l’aurait largement mérité, tout juste un téléfilm très mauvais et mal joué….mais c’est une opinion toute personnelle…Un sujet sur le forum abordait déjà ce sujet mais de manière si succincte qu’un rappel plus complet est utile. Par extension, on peut dire que ce langage est très utilisé par les politiciens en général qui peuvent ainsi nous raconter n’importe quoi tout en nous faisant croire que ce qu’ils disent est très intéressant (ou pas…), et qui permet également de nous dire quelque chose tout en signifiant réellement le contraire, cela sans être explicite (ça va? Pas trop dur à suivre?). Maintenant je vous propose un petit dictionnaire de novlangue et vous allez découvrir que cette technique est beaucoup utilisée par nos politiciens.